डेटा हार्वेस्टिंग क्या है: 2024 में वेब स्क्रैपिंग पर सबसे नए समाचार

Rajinder Singh

Deep Learning Researcher

डिजिटल युग में, मूल्यवान जानकारी कई स्रोतों पर बिखरी हुई है, वेबसाइटों से लेकर विभिन्न फॉर्मैट के दस्तावेज तक। अपने विशिष्ट उद्देश्यों के लिए इस डेटा के संग्रह और उपयोग की शक्ति की कल्पना करें। यही डेटा हार्वेस्टिंग के अर्थ है!

इस लेख में आपको डेटा हार्वेस्टिंग की एक व्यापक समझ, इसके अनुप्रयोग, शामिल प्रक्रिया, सामना की जाने वाली चुनौतियाँ और इनके उत्तर के लिए उपकरण प्रदान किए जाएंगे। आइए शुरू करते हैं!

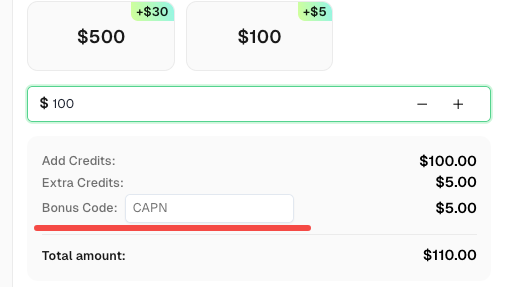

CapSolver बोनस कोड के लिए लाभ उठाएं

अपने संचालन को और भी अधिक अनुकूलित करने के अवसर को न छोड़ें! अपने CapSolver खाते के भंडारण के समय CAPN बोनस कोड का उपयोग करें और प्रत्येक भंडारण पर 5% का अतिरिक्त बोनस प्राप्त करें, कोई सीमा नहीं। CapSolver डैशबोर्ड पर जाकर अब अपना बोनस बदलें!

डेटा हार्वेस्टिंग की समझ

डेटा हार्वेस्टिंग एक या अधिक स्रोतों से जानकारी के संग्रह की प्रक्रिया है, जैसे कि वेब पृष्ठ, पाठ दस्तावेज (जैसे पीडीएफ, वर्ड फाइलें), टेबल फाइलें (जैसे स्प्रेडशीट, सीएसवी फाइलें) और मौजूदा डेटा सेट।

वेब के संदर्भ में, डेटा संग्रह अक्सर "वेब स्क्रैपिंग" के रूप में जाना जाता है, जो वेबसाइटों और वेब पृष्ठों से डेटा निकालने के लिए शामिल होता है। जब आवश्यक डेटा एकत्र कर लिया जाता है, तो इसे एकत्र किया, साफ किया जाता है और उपयोगकर्ता-मित्र रूपों में निर्यात किया जाता है, जिससे टीम सदस्यों के लिए आसानी से उपलब्ध और विश्लेषण करने योग्य बन जाता है। व्यावसायिक उपयोगकर्ता इस डेटा का उपयोग विभिन्न उद्देश्यों के लिए कर सकते हैं, जैसे कि उपयोगकर्ता प्रोफाइलिंग, निर्णय लेना, और मूल्यवान दृष्टिकोण प्राप्त करना।

2024 तक, स्वचालित तकनीकों और कृत्रिम बुद्धिमत्ता (AI) में उन्नति ने डेटा हार्वेस्टिंग को अधिक कुशल और उपलब्ध बना दिया है, ऑनलाइन और स्थानीय डेटा प्राप्ति, साथ ही जैव जानकारी अर्जन को शामिल करते हुए।

डेटा हार्वेस्टिंग के अनुप्रयोग और उपयोग मामले

डेटा हार्वेस्टिंग विभिन्न उद्योगों और अनुप्रयोगों से संबंधित कार्यों में महत्वपूर्ण भूमिका निभाता है। विभिन्न प्रकार के उपयोगकर्ता अपने अंतिम उद्देश्यों के लिए इसका उपयोग करते हैं। यहां कुछ सामान्य उपयोग मामले हैं:

- व्यक्तिगत रूप से: बेहतर डील के लिए ऑनलाइन मूल्यों की ट्रैकिंग, उत्पादकता में वृद्धि, नौकरी के अवसरों की निगरानी, व्यक्तिगत संगठन में सुधार, और दैनिक कार्यों में दक्षता में सुधार।

- कंपनियां: ग्राहक व्यवहार का विश्लेषण, बाजार रणनीति को बेहतर बनाना, उत्पाद पेशकश में सुधार, ज्ञानपूर्ण निर्णय लेना, संचालन को सुव्यवस्थित करना, और प्रतिस्पर्धी फायदा प्राप्त करना।

- सरकारें: राष्ट्रीय सुरक्षा में भाग लेना, सार्वजनिक नीतियों के निर्माण, संसाधनों के दक्ष आवंटन, सार्वजनिक राय का मूल्यांकन, और उभरती सामाजिक आवश्यकताओं में अनुकूलन।

डेटा हार्वेस्टिंग का उपयोग चिकित्सा अनुसंधान, व्यक्तिगत रूप से रोगी देखभाल, सामाजिक मीडिया मॉनिटरिंग, और बाजार विश्लेषण के लिए विज्ञापकों के लिए भी मूल्यवान है।

डेटा हार्वेस्टिंग प्रक्रिया

डेटा हार्वेस्टिंग प्रक्रिया में शामिल सामान्य चरण निम्नलिखित हैं:

- डेटा स्रोत पहचानें: अपने विशिष्ट लक्ष्य के लिए संबंधित डेटा स्रोतों की खोज करें, जैसे कि वेबसाइटें, डेटा सेट, या आवश्यक जानकारी रखने वाले भंडार।

- डेटा निकालने के उपकरण का उपयोग करें: डेटा निकालने की प्रक्रिया को सरल बनाने के लिए एक उपकरण का उपयोग करें। आपकी आवश्यकता के अनुसार, यह एक डेटा पार्सिंग पुस्तकालय, एक बिना कोड वाला उपकरण, या डेस्कटॉप एप्लिकेशन हो सकता है। स्वचालित उपकरण डेटा हार्वेस्टिंग को तेज और अधिक सटीक बनाते हैं।

- आवश्यकता के अनुसार डेटा निर्यात करें: डेटा निकालने के बाद, इसे आपकी आवश्यकता के अनुसार फॉर्मैट में बदलें। विश्लेषणात्मक उपकरणों में एकीकरण के लिए सबसे आम फॉर्मैट सीएसवी, एक्सएमएल और जेसॉन हैं। आपको संग्रहित जानकारी को एक डेटाबेस में संग्रहीत करने की आवश्यकता हो सकती है।

आइए इस प्रक्रिया के काम करने के बारे में बेहतर समझ के लिए एक वास्तविक उदाहरण लेते हैं। कैप्चा डेटा के डेटा क्रॉलिंग के उदाहरण के रूप में:

शुरू करने के लिए, अपने सिस्टम में पायथन स्थापित होने की जांच करें। अब, pip के साथ निम्न पुस्तकालय स्थापित करें:

- Requests: कैप्चा वेबसाइट पर HTTP अनुरोध भेजने के लिए उपयोग किया जाता है।

- BeautifulSoup: HTML के विश्लेषण और डेटा निकालने के लिए एक पुस्तकालय।

कैप्चा पर अनुरोध करें:

कैप्चा से डेटा स्क्रैप करने के लिए, हमें वेबसाइट पर HTTP अनुरोध भेजने और पृष्ठों के HTML सामग्री प्राप्त करने की आवश्यकता होती है। हम Requests पुस्तकालय का उपयोग करके इसे प्राप्त कर सकते हैं। एक कैप्चा उत्पाद पृष्ठ के HTML को प्राप्त करने के लिए एक उदाहरण नीचे दिया गया है: डेटा की समीक्षा करें।

python

import requests

url = "https://www.captcha.com/product-page-url"

response = requests.get(url)

html_content = response.textअब हमें पृष्ठ की HTML सामग्री मिल गई है और हम डेटा के विश्लेषण और निकालने पर आगे बढ़ सकते हैं।

BeautifulSoup के साथ HTML पार्स करें:

जब हम किसी पृष्ठ की HTML सामग्री प्राप्त कर लेते हैं, तो हम बूटस्टैप का उपयोग करके HTML का विश्लेषण कर सकते हैं और आवश्यक डेटा निकाल सकते हैं। इसमें उत्पाद जानकारी, समीक्षाएं, मूल्य आदि शामिल हो सकते हैं। एक कैप्चा पृष्ठ से उत्पाद के शीर्षक को निकालने के लिए बूटस्टैप के उपयोग का एक उदाहरण नीचे दिया गया है:

python

from bs4 import BeautifulSoup

soup = BeautifulSoup(html_content, "html.parser")

title = soup.find("span", id="productTitle").text.strip()अब हमने उत्पाद का शीर्षक निकाल लिया है और आगे के डेटा निकालने पर आगे बढ़ सकते हैं। अधिक जानकारी के लिए विस्तृत लेख देखें।

सही डेटा निकालने वाले उपकरण का चयन करें

कैप्चा मापदंडों के बढ़ते जटिलता के साथ, डेटा निकालने के लिए सही उपकरण का चयन आवश्यक हो गया है। केवल उन उपकरणों के साथ ही आप ब्लॉक होने से बच सकते हैं, जो आपके लिए कुशल और प्रभावी परिणाम प्रदान कर सकते हैं। डेटा निकालने वाले उपकरणों के दो मुख्य वर्ग हैं:

सभी के लिए: ब्राउजर एक्सटेंशन और डेस्कटॉप एप्लिकेशन जो कोड के बिना डेटा प्राप्त करने की अनुमति देते हैं। जबकि किसी भी कौशल स्तर के उपयोगकर्ता के लिए उपलब्ध होते हैं, इन उपकरणों के सीमाएं होती हैं, जैसे कि त्रुटि-प्रवण, साइटों द्वारा आसानी से पहचाने जाने वाले और लगभग कोई कस्टमाइजेशन नहीं।

विकासकर्ताओं के लिए: विभिन्न स्रोतों से डेटा निकालने के लिए डेटा पार्सिंग पुस्तकालय। उन्नत समाधान अनुरोधों को कस्टमाइज़ करने और बॉट डिटेक्शन से बचने के तरीके प्रदान करते हैं।

बिना कोड वाले उपकरण आधारभूत डेटा निकालने के लिए उपयुक्त हैं, लेकिन अधिक जटिल कार्यों के लिए आवश्यक लचीलापन की कमी होती है। विश्वसनीय और प्रभावी डेटा हार्वेस्टिंग के लिए, विकासकर्ताओं को अक्सर स्वचालित स्क्रिप्ट में कस्टम स्क्रैपिंग तर्क परिभाषित करने की आवश्यकता होती है।

हालांकि, कस्टम स्क्रिप्ट अकेले एक प्रभावी डेटा संग्रह प्रक्रिया बनाने के लिए पर्याप्त नहीं हैं। वास्तव में कैप्चा हल करने के लिए, आपको एक शक्तिशाली उपकरण की आवश्यकता होती है जैसे कि CapSolver। एक अग्रणी कैप्चा हल करने वाली सेवा के रूप में, CapSolver आपके वेब स्क्रैपिंग के दौरान सामना करने वाले विभिन्न प्रकार के कैप्चा को हल करने के लिए एपीआई और एक्सटेंशन प्रदान करता है, जिनका उपयोग उन्नत प्रणालियों द्वारा किया जाता है। अपने डेटा हार्वेस्टिंग कार्य प्रक्रिया में CapSolver के समायोजन के साथ, आप इन चुनौतियों को पार कर सकते हैं और सफल डेटा प्राप्ति सुनिश्चित कर सकते हैं।

निष्कर्ष

इस लेख ने आपको डेटा हार्वेस्टिंग की एक व्यापक समझ, इसके अनुप्रयोग, शामिल प्रक्रिया, सामना की जाने वाली चुनौतियाँ और इनके उत्तर के लिए उपकरण प्रदान किए हैं। डेटा हार्वेस्टिंग की शक्ति और CapSolver जैसे उपकरणों के उपयोग से, आप उपयोगी दृष्टिकोण प्राप्त कर सकते हैं, प्रतिस्पर्धी फायदा हासिल कर सकते हैं, और अपने व्यवसाय या व्यक्तिगत प्रयासों के लिए ज्ञानपूर्ण निर्णय ले सकते हैं। अगर आपको कैप्चा समाधान की उच्च मांग है, तो आप कस्टमर सेवा या Telegram के माध्यम से CapSolver से संपर्क कर सकते हैं और एक अनुमानित प्रस्ताव प्राप्त कर सकते हैं।

और देखें

web scrapingApr 22, 2026

रस्ट वेब स्क्रैपिंग आर्किटेक्चर लिए स्केलेबल डेटा निष्कर्षण

Rust में वेब स्क्रैपिंग के स्केलेबल आर्किटेक्चर सीखें, reqwest, scraper, असिंक्रोनस स्क्रैपिंग, हेडलेस ब्राउज़र स्क्रैपिंग, प्रॉक्सी रोटेशन, और संगत CAPTCHA का निपटारा।

web scrapingFeb 03, 2026

रॉक्सीब्राउज़र में कैप्चा हल करना कैपसॉल्वर एकीकरण के साथ

CapSolver के साथ RoxyBrowser के एकीकरण करें ताकि ब्राउज़र के कार्यों को स्वचालित किया जा सके और reCAPTCHA, Turnstile और अन्य CAPTCHAs को बायपास किया जा सके।